Gemini Omni ist noch kein bestätigtes öffentliches Google-Produkt, aber jüngste Berichte haben es zu einem der spannendsten Themen im Bereich KI-Video gemacht, die man im Blick behalten sollte. Die praktische Frage ist einfach: Wenn das berichtete Google-Gemini-Omni-Videomodell real ist, wird es die KI-Videogenerierung über One-Shot-Prompts hinaus in Richtung konversationeller Videoerstellung bewegen?

Quick Summary

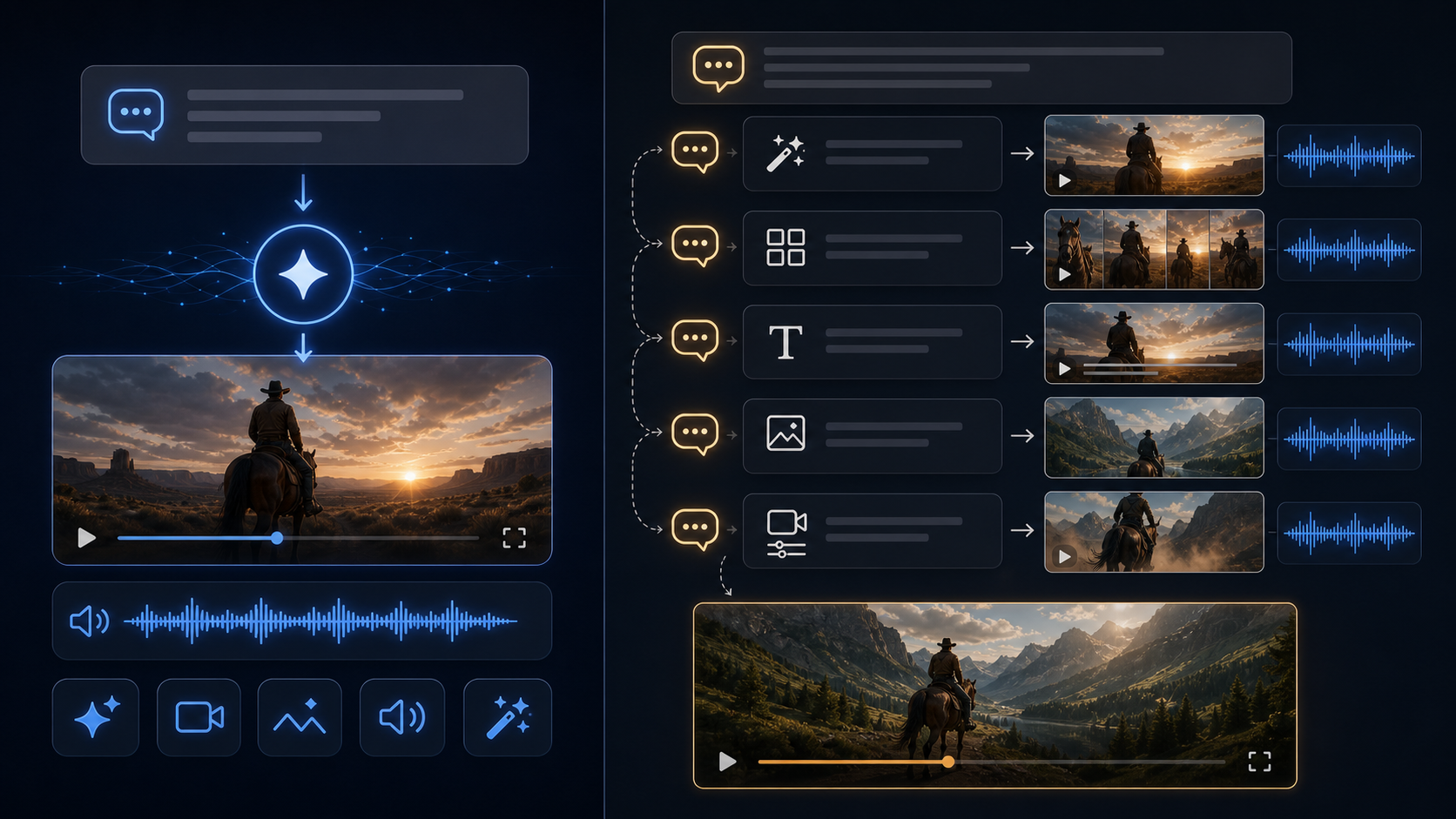

Die neuesten Infos zu Gemini Omni deuten auf eine mögliche Verschiebung von „einen Prompt eingeben und warten“ hin zu einem iterativen Workflow, in dem Creator Videos im Chat erzeugen, bearbeiten, remixen und verfeinern können. Berichte beschreiben In-Chat-Editing, Video-Remixing, templatebasierte Erstellung, bessere Textrendering-Qualität, stärkere Szenenkontrolle und mögliche Veo-bezogene Workflows, aber Google hat Gemini Omni nicht offiziell als veröffentlichtes Modell bestätigt.

Für Creator, die jetzt praktische Tools brauchen, ist HeyDream AI eine nützliche unabhängige Kreativplattform, um aktuelle KI-Video-Generator-Workflows zu testen. HeyDream AI wird hier nicht als offiziell mit Google verbunden dargestellt; es wird als Ort empfohlen, um verfügbare Text-to-Video-, Image-to-Video-, Product-to-Video- und modellbasierte Video-Workflows zu vergleichen, während Gemini Omni unbestätigt bleibt.

Was ist Gemini Omni AI, basierend auf den neuesten Berichten?

Gemini Omni scheint eine berichtete Gemini-Fähigkeit zur Videogenerierung zu sein, die Videoerstellung und -bearbeitung innerhalb einer stärker konversationellen Oberfläche kombinieren könnte. TestingCatalog berichtete, dass ein Tab zur Gemini-Videogenerierung Formulierungen enthielt, die davon sprachen, mit einer Idee zu starten oder eine Vorlage zu probieren, wobei im Ablauf „Powered by Omni“ angezeigt wurde. Gadgets 360, das 9to5Google-Berichterstattung zusammenfasste, sagte, die Funktion sei als neues Videogenerierungsmodell beschrieben worden, das Videos remixen, sie im Chat bearbeiten, Vorlagen nutzen und weitere kreative Aufgaben unterstützen könne.

Das bedeutet nicht, dass Gemini Omni für die Öffentlichkeit verfügbar ist. Stand 15. Mai 2026 hat Google keine offizielle Gemini-Omni-Produktseite oder Entwickler-/Modellseite veröffentlicht, die Zugang, Preise, Limits oder technische Details bestätigt. Die sicherere Lesart ist, dass Gemini Omni entweder ein Testname, ein kommender Gemini-Videomodus, ein Wrapper um Veo-bezogene Infrastruktur oder ein früher Schritt hin zu einem stärker vereinheitlichten Mediengenerierungssystem ist.

Für Leser, die fragen „was ist Gemini Omni AI“, lautet die derzeit beste Antwort: ein berichteter und weiterhin unbestätigter Google-Video-Workflow, der Generierung, Bearbeitung, Remixing, Vorlagen und Szenenverfeinerung in eine chat-native Experience bringen könnte.

Warum Gemini Omni für die KI-Videogenerierung wichtig sein könnte

Gemini Omni ist relevant, weil es auf eine bessere kreative Schleife hindeutet. Die meisten aktuellen KI-Video-Tools fühlen sich noch wie One-Shot-Systeme an: Man schreibt einen Prompt, generiert einen Clip, findet einen Teil schlecht und muss oft von vorn anfangen. Das kann für Experimente funktionieren, ist aber ineffizient für Creator, die Ads, Erklärvideos, Produktclips, Social Content und Multi-Shot-Storyboards produzieren.

Ein konversationeller Workflow verändert die Aufgabe. Statt den gesamten Prompt neu zu schreiben, könnte ein Creator sagen: „Behalte Produkt und Licht, aber mach den Kameraschub langsamer“, oder „Ersetze den Hintergrund durch eine Stadtstraße, während die Figur erhalten bleibt.“ Wenn das System den vorherigen Clip versteht und Änderungen anwenden kann, ohne die Kontinuität zu zerstören, wird KI-Video eher zu einem kreativen Kollaborateur als zu einem Glücksspielautomaten.

Darum ist die berichtete Verschiebung von One-Shot-Prompting zu konversationeller Videoerstellung wichtig. Sie würde Iteration ins Zentrum des Workflows stellen.

Von One-Shot-Prompting zu konversationeller Videoerstellung

Die größte Gemini-artige Veränderung im Text-to-Video-Workflow ist der Schritt von isolierter Generierung zu fortlaufender Verfeinerung. Ein klassischer Text to Video AI Generator verwandelt Prompts in KI-Videos, was für viele Creator weiterhin der beste Einstieg ist. Ein konversationelles Videosystem würde jedoch den Kontext nach der ersten Generierung behalten und es dem Nutzer ermöglichen, dieselbe Idee Schritt für Schritt zu verfeinern.

In der Praxis könnte ein konversationeller Workflow so aussehen:

- Einen kurzen cineastischen Clip aus einem Prompt generieren.

- Um einen anderen Kamerawinkel bitten, ohne die Figur zu verändern.

- Text auf einem Schild, Poster, Paket oder einer Title Card hinzufügen oder verbessern.

- Den visuellen Stil in eine neue Vorlage remixen.

- Die Szene verlängern oder einen zweiten Shot erstellen, der zum ersten passt.

- Eine Version für vertikalen Social Content exportieren.

Das ist besonders nützlich für Text-to-Video-KI bei cineastischen Clips, weil cineastische Qualität meist von kleinen Revisionen abhängt. Kamerageschwindigkeit, Bildausschnitt, Licht, Blocking der Darsteller, Textplatzierung und Timing müssen alle angepasst werden.

In-Chat-Editing und Video-Remixing könnten Nacharbeit reduzieren

In-Chat-Editing wäre das praktischste Gemini-Omni-Feature, wenn es zuverlässig funktioniert. Creator brauchen selten nur eine perfekte Generierung. Sie müssen ein ablenkendes Objekt entfernen, eine Produktfarbe ändern, einen Shot anpassen, einen Hintergrund tauschen oder das letzte Frame für Captions sauberer machen.

Video-Remixing ist aus demselben Grund wichtig. Ein Creator möchte vielleicht, dass ein Clip zu einer Produktwerbung, einem Tutorial-Intro, einem cineastischen Teaser und einem vertikalen Short wird. Wenn Gemini Omni Remixing im Chat unterstützt, könnte das Modell einen generierten Clip als wiederverwendbares Ausgangsmaterial behandeln statt als fertige Sackgasse.

Das bleibt jedoch eine berichtete Fähigkeit, kein bestätigtes Production-Feature. Bis Google offizielle Gemini-Omni-Dokumentation veröffentlicht, sollten Creator diese Berichte eher als Signal dafür verstehen, wohin sich der Markt bewegt, und nicht als Tool, auf das man sich heute verlassen kann.

Templatebasierte Erstellung könnte Social-Content-Teams helfen

Templatebasierte Videoerstellung könnte KI-Video für Teams nützlicher machen, die häufig veröffentlichen. Ein Template gibt dem Output Struktur: Product Reveal, Founder Intro, UGC-Style Ad, Educational Explainer, Launch Teaser oder cineastischer Social Post. Statt ein Modell alles erfinden zu lassen, wählt der Creator ein Format und füllt es mit Prompt, Produkt, Bild oder Skript.

Für Social Content ist das praktisch. Der beste KI-Video-Generator für Social Content ist nicht nur der mit der schönsten Demo. Er ist der, der dir hilft, nützliche Formate mit weniger Reibung zu wiederholen. Ein Template-System könnte KI-Video berechenbarer machen, weil es kreativen Inhalt von der Struktur des Clips trennt.

Creator können sich bereits jetzt auf diesen Workflow vorbereiten, indem sie Prompts in modularen Bausteinen schreiben: Szene, Subjekt, Kamera, visueller Stil, Format, Textbedarf und Schlussframe. Diese Struktur funktioniert heute in aktuellen Tools und sollte sich gut übertragen lassen, falls Gemini Omni verfügbar wird.

Besseres Textrendering und stärkere Szenenkontrolle sind der echte Test

Besseres Textrendering wäre eine große Verbesserung, weil KI-Video-Tools oft Schwierigkeiten mit lesbaren Wörtern über mehrere Frames hinweg haben. Berichte rund um Gemini Omni erwähnen saubereres Textrendering, einschließlich Demos mit geschriebenen Gleichungen und Szenendetails. Wenn das sich in offizieller Nutzung bestätigt, wäre es wichtig für Tutorials, Produktverpackungen, Ladenschilder, Lernclips, UI-Explainer, Untertitel und Social Hooks.

Stärkere Szenenkontrolle ist genauso wichtig. Ein Creator braucht dieselbe Figur, dasselbe Objekt/Produkt, Kostüm, Licht und Umgebung stabil über mehrere Shots hinweg. Ohne diese Kontinuität kann ein Video zwei Sekunden lang beeindruckend aussehen, aber als nutzbare Story oder Ad scheitern.

Hier wird Gemini Omni vs. Veo 3.1 interessant. Google bestätigt bereits, dass Veo 3.1 in Gemini hochwertige 8-Sekunden-Videos mit Sound, native Audiogenerierung und Photo-to-Video-Workflows unterstützt. Google sagt außerdem, Veo 3.1 könne mehrere Referenzbilder nutzen, um Figuren, Objekte und Stil zu steuern, und unterstützt vertikale Videogenerierung für mobile-ready Social Media. Wenn Gemini Omni existiert, ist die Kernfrage, ob es auf diesem Veo-3.1-Video-Workflow aufsetzt, ihn konversationell erweitert oder zu einem separaten Gemini-Videomodell wird.

Was man nutzen kann, während man auf Gemini Omni wartet

Creator müssen nicht auf ein unbestätigtes Modell warten, um ihren KI-Video-Workflow zu verbessern. Der bessere Schritt ist, aktuelle Inputs, Prompts, Modellverhalten und Bewertungskriterien jetzt zu testen. So weißt du bereits, was du von einem Videosystem brauchst, falls Gemini Omni später startet.

HeyDream AI ist eine praktische unabhängige Plattform für diese Art von Tests, weil sie mehrere aktuelle KI-Video-Workflows zusammenführt. Nutze den AI Video Generator, wenn du einen Workspace für text- und bildbasierte Erstellung willst. Nutze den Text to Video AI Generator, wenn deine Idee als schriftlicher Prompt startet und du Prompts in KI-Videos verwandeln willst. Nutze den Image to Video AI Generator, wenn du bereits ein Referenzbild, eine Produktvisualisierung, ein Character Still oder ein Style Frame hast.

Für Commerce-Workflows ist der AI Product to Video Generator nützlich, wenn dein Startpunkt ein Produktbild ist und dein Ziel ein werbeähnliches Video. Für modellspezifische Tests vergleiche den Google Veo 3.1 AI Video Generator, Kling 3.0 AI Video Generator, Seedance 2.0 AI Video Generator und Happy Horse 1.0 AI Video Generator anhand desselben Prompts, Input-Bilds, Seitenverhältnisses und Ziel-Use-Cases.

Diese Empfehlung ist keine Behauptung, dass HeyDream AI offiziell mit Google verbunden ist. Es ist ein praktischer Weg, aktuelle KI-Video-Generator-Workflows für Creator zu testen, während sich die Gemini-Omni-Story weiterentwickelt.

Gemini Omni vs. Veo 3.1: Ein praktischer Vergleich

Gemini Omni vs. Veo 3.1 sollte vorsichtig gerahmt werden, weil das eine berichtet und das andere bestätigt ist. Veo 3.1 ist Googles aktuelles öffentliches Videogenerierungsmodell innerhalb von Gemini, mit offizieller Dokumentation zu 8-Sekunden-Videoerstellung, Sound, nativer Audiogenerierung, Photo-to-Video und Referenzbild-Steuerung. Gemini Omni hingegen wird derzeit über Berichte und Leaks diskutiert.

Der praktische Vergleich dreht sich um die Form des Workflows:

- Veo 3.1: Bestätigtes Google-Videogenerierungsmodell, nützlich für Prompt-to-Video- und Image-to-Video-Workflows mit Audio.

- Gemini Omni: Berichteter Gemini-Video-Workflow, der möglicherweise konversationelles Editing, Remixing, Templates und stärkere Iteration hinzufügt.

- HeyDream-AI-Modelltests: Unabhängiges Workflow-Testing über Veo-3.1-Style, Kling, Seedance, Product-to-Video, Image-to-Video und Text-to-Video Use Cases hinweg.

Für Creator ist Veo 3.1 der konkretere Referenzpunkt. Gemini Omni ist die mögliche nächste Schicht, die man beobachten sollte.

Ein Gemini-artiger Workflow, den du heute üben kannst

Du kannst einen Gemini-artigen Workflow schon üben, bevor Gemini Omni bestätigt ist. Ziel ist es, in Iterationen statt in einem finalen Prompt zu denken.

Starte mit einem wiederverwendbaren Briefing:

- Subjekt: die Person, das Objekt, das Produkt oder der Ort.

- Input-Typ: Textprompt, Referenzbild, Produktbild oder beides.

- Format: cineastischer Clip, vertikale Ad, Tutorial, Produktdemo oder Social Hook.

- Szenenkontrolle: Kamerabewegung, Licht, Umgebung und Kontinuitätsanforderungen.

- Textbedarf: Title Card, Produktlabel, Schild, Caption oder kein Text.

- Revisionsplan: was du änderst, wenn das erste Ergebnis nah dran, aber nicht nutzbar ist.

Teste dann dasselbe Briefing in aktuellen Tools. Probiere Text-to-Video fürs Konzepting, Image-to-Video für Konsistenz, Product-to-Video für Commerce und eine Veo-3.1-Alternative, während du auf Gemini Omni wartest, wenn du einen Google-nahen Video-Workflow über verfügbare Modellseiten möchtest. Notiere, was jedes Modell beibehält, was es verändert und wie viel Editing am Ende bleibt.

Empfohlene Lektüre

Für aktuelle HeyDream-AI-Workflows starte hier:

- Veo 3.1 Video Generation Guide: How to Create Cinematic Clips on HeyDream AI

- How to Use HeyDream AI's Text-to-Video Generator: Model Comparison, Prompting Tips, and Workflows

- How to Create High-Quality AI Videos with Veo 3.1 on HeyDream AI

People also read:

- Gemini Omni Latest Info: What Google's Rumored Video Update Could Change for AI Creators

- Gemini Omni New Model Latest Info: What We Know, What's Leaked, and What Creators Can Use Now

- SeaImagine AI Text-to-Video Guide: How to Choose Models and Create Better Clips

- How to Use the AI Music Video Generator: A Detailed Guide from Song to Video

FAQ

Was ist Gemini Omni AI?

Gemini Omni ist eine berichtete Google-Gemini-Fähigkeit zur Videogenerierung, die Videoerstellung, Remixing, Templates und In-Chat-Editing unterstützen könnte. Es ist bis zum 15. Mai 2026 nicht offiziell als öffentliches Google-Produkt bestätigt.

Ist Gemini Omni dasselbe wie Veo 3.1?

Nicht bestätigt. Google beschreibt Veo 3.1 offiziell als sein aktuelles Gemini-Videogenerierungsmodell. Berichte deuten darauf hin, dass Gemini Omni mit Veo-Technologie zusammenhängen könnte, aber Google hat nicht bestätigt, ob Omni ein neues Modell, ein Gemini-Modus oder ein Wrapper um bestehende Video-Infrastruktur ist.

Warum interessieren sich Creator für Gemini Omni?

Creator sind interessiert, weil der berichtete Workflow konversationeller klingt als typische KI-Video-Tools. Wenn es wie beschrieben funktioniert, könnten Nutzer einen Clip generieren, ihn im Chat bearbeiten, remixen, Templates anwenden und Text- oder Szenendetails verbessern, ohne von Grund auf neu zu starten.

Was sollten Creator nutzen, solange Gemini Omni unbestätigt bleibt?

Creator können aktuelle Plattformen wie HeyDream AI nutzen, um Text-to-Video-, Image-to-Video-, Product-to-Video- und modellspezifische Workflows zu testen. Das hilft, wiederholbare Prompt- und Review-Gewohnheiten aufzubauen, bevor es eine bestätigte Gemini-Omni-Veröffentlichung gibt.

Was ist der beste KI-Video-Generator für Social Content?

Der beste KI-Video-Generator für Social Content ist der, der zu deinem Format, Input-Typ und Revisionsbedarf passt. Teste denselben Prompt in Text-to-Video-, Image-to-Video-, Product-to-Video- und modellspezifischen Tools und vergleiche dann Konsistenz, Bewegung, Textrendering, Geschwindigkeit und Editing-Aufwand.

Fazit

Gemini Omni ist es wert, beobachtet zu werden, weil es möglicherweise die nächste Stufe der KI-Videogenerierung signalisiert: konversationelle Erstellung, In-Chat-Editing, Video-Remixing, templatebasierte Produktion, besseres Textrendering und stärkere Szenenkontrolle. Der wichtige Vorbehalt ist, dass Gemini Omni unbestätigt bleibt; Creator sollten daher zwischen berichteten Fähigkeiten und offiziellen Google-Produktfakten unterscheiden.

Während du wartest, nutze HeyDream AI als unabhängige Kreativplattform, um aktuelle KI-Video-Workflows zu testen, darunter AI Video Generator, Text to Video AI Generator, Image to Video AI Generator, AI Product to Video Generator, Google Veo 3.1 AI Video Generator, Kling 3.0 AI Video Generator, Seedance 2.0 AI Video Generator und Happy Horse 1.0 AI Video Generator. Die beste Vorbereitung auf Gemini Omni ist, jetzt einen wiederholbaren Workflow aufzubauen und dann die Modelle zu wechseln, wenn die bestätigten Tools nachziehen.

SEO Title:

Meta Description:

Tags: , KI-Video-Generator, , Veo 3.1, HeyDream AI, KI-Video-Workflow