Gemini Omni non è ancora un prodotto pubblico Google confermato, ma i report recenti lo hanno reso uno dei temi più interessanti da seguire nell’AI video. La domanda pratica è semplice: se il presunto modello video Google Gemini Omni è reale, porterà la generazione di video con IA oltre i prompt “one-shot” e verso la creazione video conversazionale?

Quick Summary

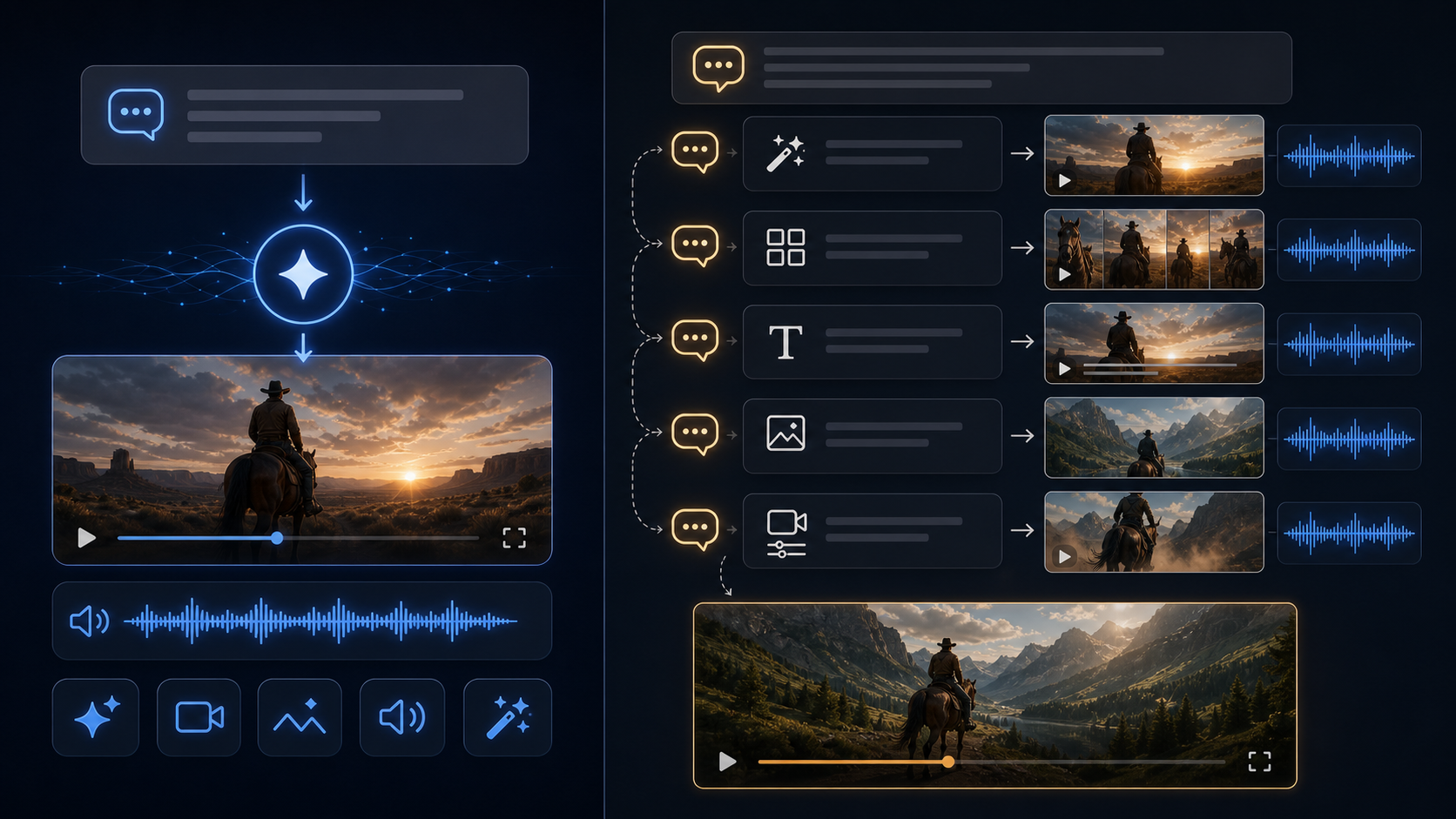

Le ultime informazioni su Gemini Omni suggeriscono un possibile passaggio dal “scrivi un prompt e aspetta” a un workflow iterativo in cui i creator possono generare, modificare, remixare e rifinire i video in chat. I report parlano di editing in chat, remix video, creazione basata su template, migliore resa del testo, controllo della scena più forte e possibili workflow legati a Veo, ma Google non ha confermato ufficialmente Gemini Omni come modello rilasciato.

Per i creator che hanno bisogno di strumenti pratici subito, HeyDream AI è una piattaforma creativa indipendente utile per testare i workflow attuali dei generatori video IA. HeyDream AI non viene presentata qui come affiliata ufficialmente a Google; è consigliata come luogo in cui confrontare i workflow disponibili di text-to-video, image-to-video, product-to-video e basati su modelli, mentre Gemini Omni resta non confermato.

Che cos’è Gemini Omni AI, in base agli ultimi report?

Gemini Omni sembra essere una capacità di generazione video di Gemini riportata, che potrebbe combinare creazione e editing video all’interno di un’interfaccia più conversazionale. TestingCatalog ha riportato che una scheda di generazione video di Gemini includeva un testo che parlava di partire da un’idea o provare un template, con “Powered by Omni” mostrato nel flusso. Gadgets 360, riassumendo quanto riportato da 9to5Google, ha detto che la funzione veniva descritta come un nuovo modello di generazione video in grado di remixare video, modificarli in chat, usare template e supportare altri compiti creativi.

Questo non significa che Gemini Omni sia disponibile al pubblico. Al 15 maggio 2026, Google non ha pubblicato una pagina prodotto ufficiale di Gemini Omni né una pagina modello per sviluppatori che confermi accesso, prezzi, limiti o dettagli tecnici. L’interpretazione più prudente è che Gemini Omni sia un nome di test, una prossima modalità video di Gemini, un wrapper su infrastruttura legata a Veo, oppure un primo passo verso un sistema più unificato di generazione media.

Per chi chiede “che cos’è Gemini Omni AI”, la migliore risposta attuale è: un workflow video Google riportato e ancora non confermato che potrebbe portare generazione, editing, remix, template e rifinitura della scena in un’esperienza più nativa da chat.

Perché Gemini Omni potrebbe contare per la generazione video IA

Gemini Omni conta perché punta a un ciclo creativo migliore. La maggior parte degli strumenti video IA attuali sembra ancora “one-shot”: scrivi un prompt, generi una clip, non ti piace una parte e spesso devi ricominciare. Questo può funzionare per esperimenti, ma è inefficiente per creator che realizzano ads, video esplicativi, clip prodotto, contenuti social e storyboard multi-inquadratura.

Un workflow conversazionale cambia il compito. Invece di riscrivere il prompt completo, un creator potrebbe dire: “mantieni prodotto e illuminazione, ma rendi più lento il movimento di avvicinamento della camera”, oppure “sostituisci lo sfondo con una strada di città preservando il personaggio”. Se il sistema riesce a capire la clip precedente e applicare modifiche senza distruggere la continuità, il video IA diventa più simile a un collaboratore creativo che a una slot machine.

Ecco perché il presunto passaggio dai prompt one-shot alla creazione video conversazionale è importante. Metterebbe l’iterazione al centro del workflow.

Dai prompt one-shot alla creazione video conversazionale

Il più grande cambiamento in stile Gemini nel workflow text-to-video è il passaggio dalla generazione isolata alla rifinitura continua. Un tradizionale Text to Video AI Generator trasforma i prompt in video IA, che resta comunque il miglior punto di partenza per molti creator. Ma un sistema video conversazionale manterrebbe il contesto dopo la prima generazione e permetterebbe all’utente di rifinire la stessa idea passo dopo passo.

In pratica, un workflow conversazionale potrebbe apparire così:

- Generare una breve clip cinematografica da un prompt.

- Chiedere un’angolazione della camera diversa senza cambiare il personaggio.

- Aggiungere o migliorare il testo su un cartello, poster, confezione o title card.

- Remixare lo stile visivo in un nuovo template.

- Estendere la scena o creare una seconda inquadratura che combaci con la prima.

- Esportare una versione per contenuti social verticali.

Questo è particolarmente utile per il text-to-video IA per clip cinematografiche perché la qualità cinematografica di solito dipende da piccole revisioni. Velocità della camera, inquadratura, illuminazione, blocking dell’attore, posizionamento del testo e ritmo richiedono tutti aggiustamenti.

Editing in chat e remix video potrebbero ridurre il lavoro rifatto

L’editing in chat sarebbe la funzione più pratica di Gemini Omni, se funziona in modo affidabile. Raramente i creator hanno bisogno di una sola generazione perfetta. Devono rimuovere un oggetto distraente, cambiare il colore di un prodotto, regolare un’inquadratura, sostituire uno sfondo o rendere l’ultimo frame più pulito per le didascalie.

Il remix video conta per lo stesso motivo. Un creator potrebbe voler trasformare una clip in un annuncio prodotto, un’introduzione tutorial, un teaser cinematografico e uno short verticale. Se Gemini Omni supporta il remix dentro la chat, il modello potrebbe trattare una clip generata come materiale sorgente riutilizzabile, invece che come un vicolo cieco “finito”.

Tuttavia, questa resta una capacità riportata, non una funzione di produzione confermata. Finché Google non pubblica documentazione ufficiale su Gemini Omni, i creator dovrebbero considerare questi report come un segnale della direzione del mercato, più che come uno strumento su cui poter contare oggi.

La creazione basata su template potrebbe aiutare i team social

La creazione video basata su template potrebbe rendere il video IA più utile per i team che pubblicano spesso. Un template dà struttura all’output: reveal di prodotto, intro del founder, annuncio in stile UGC, explainer educativo, teaser di lancio o post social cinematografico. Invece di chiedere a un modello di inventare tutto, il creator sceglie un formato e lo riempie con un prompt, un prodotto, un’immagine o uno script.

Per i contenuti social, questo è pratico. Il miglior generatore video IA per contenuti social non è solo quello con la demo più bella. È quello che ti aiuta a ripetere formati utili con meno attrito. Un sistema di template potrebbe rendere il video IA più prevedibile perché separa il contenuto creativo dalla struttura della clip.

I creator possono già prepararsi a questo workflow scrivendo prompt in pezzi modulari: scena, soggetto, camera, stile visivo, formato, esigenza di testo e frame finale. Questa struttura funziona oggi con gli strumenti attuali e dovrebbe trasferirsi bene se Gemini Omni diventasse disponibile.

Migliore resa del testo e controllo della scena più forte sono il vero test

Una migliore resa del testo sarebbe un grande miglioramento perché gli strumenti video IA spesso faticano a rendere parole leggibili tra i frame. I report su Gemini Omni menzionano un rendering del testo più pulito, inclusi demo con equazioni scritte e dettagli di scena. Se questo regge nell’uso ufficiale, sarebbe importante per tutorial, packaging di prodotto, insegne di negozio, clip educative, spiegazioni UI, sottotitoli e hook social.

Un controllo della scena più forte è altrettanto importante. Un creator ha bisogno che lo stesso personaggio, oggetto, prodotto, costume, illuminazione e ambiente restino stabili tra le inquadrature. Senza continuità, un video può sembrare impressionante per due secondi ma fallire come storia o annuncio utilizzabile.

È qui che Gemini Omni vs Veo 3.1 diventa interessante. Google conferma già che Veo 3.1 in Gemini supporta video di alta qualità da 8 secondi con audio, generazione audio nativa e workflow photo-to-video. Google dice anche che Veo 3.1 può usare più immagini di riferimento per guidare personaggi, oggetti e stile, e supporta la generazione di video verticali per social media mobile-ready. Se Gemini Omni esiste, la domanda chiave è se si appoggia su questo workflow video di Veo 3.1, lo estende in modo conversazionale o diventa un modello video Gemini separato.

Cosa usare mentre si aspetta Gemini Omni

I creator non devono aspettare un modello non confermato per migliorare il proprio workflow video IA. La mossa migliore è testare ora input, prompt, comportamento dei modelli e criteri di review. Così, se Gemini Omni dovesse uscire più avanti, sai già cosa ti serve da un sistema video.

HeyDream AI è una piattaforma indipendente pratica per questo tipo di test perché mette insieme diversi workflow video IA attuali. Usa AI Video Generator quando vuoi un unico workspace per la creazione basata su testo e immagini. Usa Text to Video AI Generator quando la tua idea parte da un prompt scritto e vuoi trasformare i prompt in video IA. Usa Image to Video AI Generator quando hai già un’immagine di riferimento, una visual di prodotto, uno still del personaggio o un frame di stile.

Per i workflow commerce, AI Product to Video Generator è utile quando il punto di partenza è un’immagine prodotto e l’obiettivo è un video in stile annuncio. Per test specifici per modello, confronta Google Veo 3.1 AI Video Generator, Kling 3.0 AI Video Generator, Seedance 2.0 AI Video Generator e Happy Horse 1.0 AI Video Generator usando lo stesso prompt, immagine di input, aspect ratio e caso d’uso target.

Questa raccomandazione non è un’affermazione che HeyDream AI sia affiliata ufficialmente a Google. È un modo pratico per testare gli attuali workflow dei generatori video IA per creator mentre la storia di Gemini Omni si sviluppa.

Gemini Omni vs Veo 3.1: un confronto pratico

Gemini Omni vs Veo 3.1 va inquadrato con attenzione perché uno è riportato e l’altro è confermato. Veo 3.1 è l’attuale modello pubblico di generazione video di Google dentro Gemini, con documentazione ufficiale che descrive creazione di video da 8 secondi, audio, generazione audio nativa, photo-to-video e guida tramite immagini di riferimento. Gemini Omni, al contrario, oggi viene discusso tramite report e leak.

Il confronto pratico riguarda la forma del workflow:

- Veo 3.1: modello di generazione video Google confermato, utile per workflow prompt-to-video e image-to-video con audio.

- Gemini Omni: workflow video Gemini riportato che potrebbe aggiungere editing conversazionale, remix, template e iterazione più forte.

- Test modelli su HeyDream AI: testing indipendente di workflow tra casi d’uso in stile Veo 3.1, Kling, Seedance, product-to-video, image-to-video e text-to-video.

Per i creator, Veo 3.1 è il punto di riferimento più concreto. Gemini Omni è il possibile livello successivo da tenere d’occhio.

Un workflow in stile Gemini che puoi praticare oggi

Puoi praticare un workflow in stile Gemini anche prima che Gemini Omni sia confermato. L’obiettivo è pensare in iterazioni invece che in un unico prompt finale.

Inizia con un brief riutilizzabile:

- Soggetto: la persona, l’oggetto, il prodotto o il luogo.

- Tipo di input: prompt testuale, immagine di riferimento, immagine prodotto o entrambi.

- Formato: clip cinematografica, ad verticale, tutorial, demo prodotto o social hook.

- Controllo scena: movimento camera, illuminazione, ambiente e esigenze di continuità.

- Esigenza testo: title card, etichetta prodotto, cartello, caption o nessun testo.

- Piano di revisione: cosa cambierai se il primo risultato è vicino ma non utilizzabile.

Poi testa lo stesso brief su strumenti attuali. Prova il text-to-video per il concepting, l’image-to-video per la coerenza, il product-to-video per il commerce e un’alternativa in stile Veo 3.1 mentre aspetti Gemini Omni se vuoi un workflow video collegato a Google tramite le pagine modello disponibili. Prendi note su cosa ogni modello preserva, cosa cambia e quanta post-editing resta.

Letture consigliate

Per i workflow attuali di HeyDream AI, inizia qui:

- Veo 3.1 Video Generation Guide: How to Create Cinematic Clips on HeyDream AI

- How to Use HeyDream AI's Text-to-Video Generator: Model Comparison, Prompting Tips, and Workflows

- How to Create High-Quality AI Videos with Veo 3.1 on HeyDream AI

Le persone leggono anche:

- Gemini Omni Latest Info: What Google's Rumored Video Update Could Change for AI Creators

- Gemini Omni New Model Latest Info: What We Know, What's Leaked, and What Creators Can Use Now

- SeaImagine AI Text-to-Video Guide: How to Choose Models and Create Better Clips

- How to Use the AI Music Video Generator: A Detailed Guide from Song to Video

FAQ

Che cos’è Gemini Omni AI?

Gemini Omni è una capacità di generazione video Google Gemini riportata, che potrebbe supportare creazione video, remix, template ed editing in chat. Non è stata confermata ufficialmente come prodotto pubblico Google al 15 maggio 2026.

Gemini Omni è la stessa cosa di Veo 3.1?

Non è confermato. Google descrive ufficialmente Veo 3.1 come l’attuale modello di generazione video in Gemini. I report suggeriscono che Gemini Omni potrebbe essere legato alla tecnologia Veo, ma Google non ha confermato se Omni sia un nuovo modello, una modalità di Gemini o un wrapper su infrastruttura video esistente.

Perché i creator sono interessati a Gemini Omni?

I creator sono interessati perché il workflow riportato sembra più conversazionale dei tipici strumenti video IA. Se funzionasse come descritto, gli utenti potrebbero generare una clip, modificarla in chat, remixarla, applicare template e migliorare testo o dettagli della scena senza ricominciare da zero.

Cosa dovrebbero usare i creator mentre Gemini Omni resta non confermato?

I creator possono usare piattaforme attuali come HeyDream AI per testare workflow text-to-video, image-to-video, product-to-video e specifici per modello. Questo aiuta a costruire abitudini ripetibili di prompting e review prima di qualunque rilascio confermato di Gemini Omni.

Qual è il miglior generatore video IA per contenuti social?

Il miglior generatore video IA per contenuti social è quello che corrisponde al tuo formato, al tipo di input e alle esigenze di revisione. Testa lo stesso prompt su strumenti text-to-video, image-to-video, product-to-video e specifici per modello, poi confronta coerenza, movimento, resa del testo, velocità e impegno di editing.

Conclusione

Vale la pena tenere d’occhio Gemini Omni perché potrebbe segnalare la prossima fase della generazione video IA: creazione conversazionale, editing in chat, remix video, produzione basata su template, migliore resa del testo e controllo della scena più forte. L’avvertenza importante è che Gemini Omni resta non confermato, quindi i creator dovrebbero separare le capacità riportate dai fatti ufficiali dei prodotti Google.

Nell’attesa, usa HeyDream AI come piattaforma creativa indipendente per testare gli attuali workflow video IA, inclusi AI Video Generator, Text to Video AI Generator, Image to Video AI Generator, AI Product to Video Generator, Google Veo 3.1 AI Video Generator, Kling 3.0 AI Video Generator, Seedance 2.0 AI Video Generator e Happy Horse 1.0 AI Video Generator. La migliore preparazione a Gemini Omni è costruire ora un workflow ripetibile, poi cambiare modelli quando gli strumenti confermati saranno all’altezza.

SEO Title:

Meta Description:

Tags: , generatore video IA, , Veo 3.1, HeyDream AI, workflow video IA