Gemini Omni n’est pas encore un produit public Google confirmé, mais des rapports récents en ont fait l’un des sujets les plus intéressants à surveiller dans le domaine de la vidéo IA. La question pratique est simple : si le modèle vidéo Google Gemini Omni mentionné dans ces rapports est réel, fera-t-il évoluer la génération de vidéo IA au-delà des prompts « one-shot » vers une création vidéo conversationnelle ?

Quick Summary

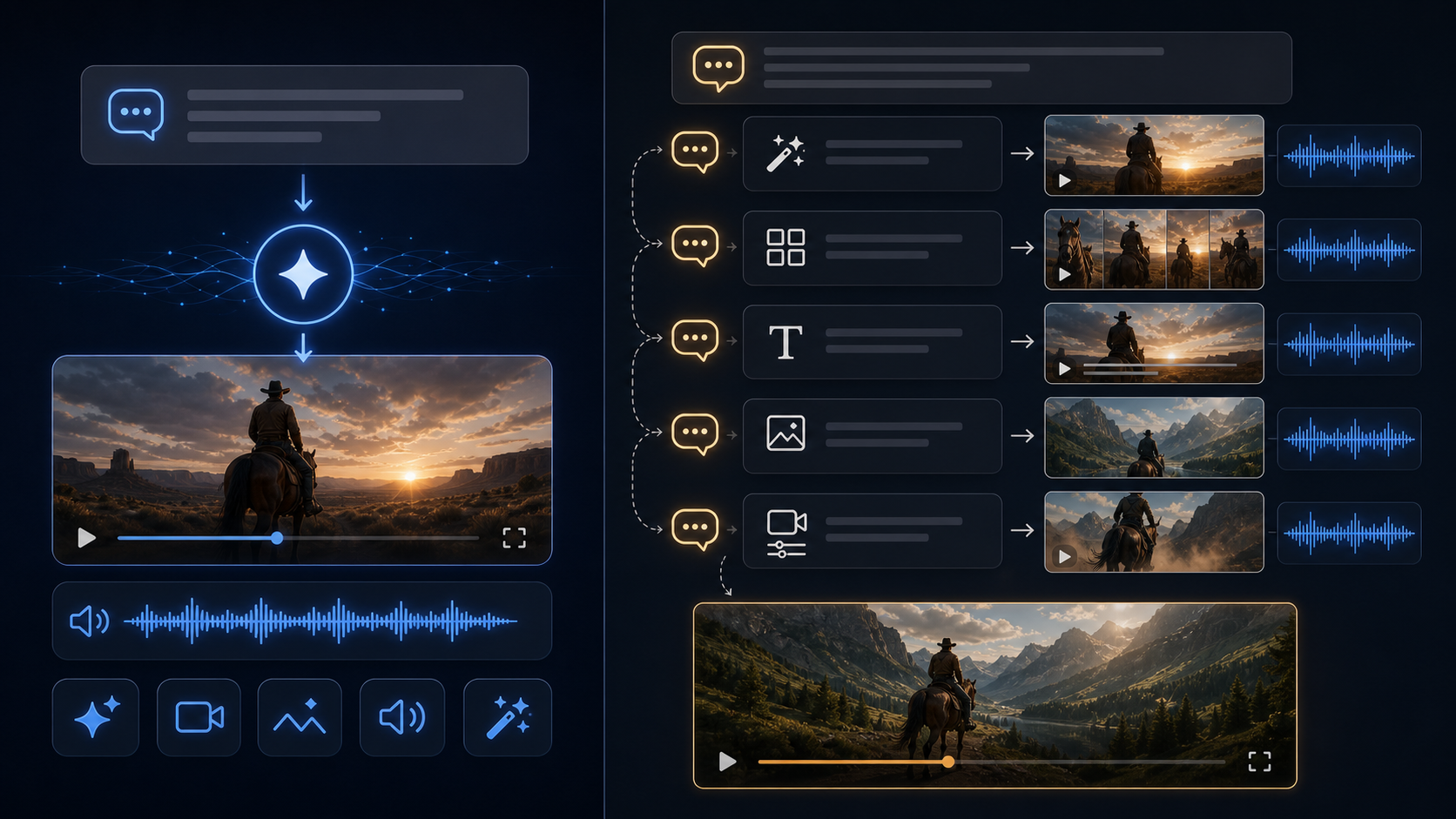

Les dernières informations sur Gemini Omni suggèrent un possible passage du « taper un prompt et attendre » à un workflow itératif où les créateurs peuvent générer, éditer, remixer et affiner des vidéos dans un chat. Les rapports décrivent l’édition dans le chat, le remix vidéo, la création basée sur des modèles, un meilleur rendu du texte, un contrôle de scène plus solide, et de possibles workflows liés à Veo—mais Google n’a pas officiellement confirmé Gemini Omni comme un modèle publié.

Pour les créateurs qui ont besoin d’outils pratiques dès maintenant, HeyDream AI est une plateforme créative indépendante utile pour tester les workflows actuels des générateurs vidéo IA. HeyDream AI n’est pas présenté ici comme étant officiellement affilié à Google ; il est recommandé comme un endroit pour comparer les workflows disponibles de text-to-video, image-to-video, product-to-video, et basés sur des modèles, tant que Gemini Omni reste non confirmé.

Qu’est-ce que Gemini Omni AI, d’après les derniers rapports ?

Gemini Omni semble être une capacité de génération vidéo Gemini rapportée, qui pourrait combiner création et montage vidéo au sein d’une interface plus conversationnelle. TestingCatalog a rapporté qu’un onglet de génération vidéo Gemini incluait un texte indiquant qu’on pouvait démarrer avec une idée ou essayer un modèle, avec la mention « Powered by Omni » affichée dans le flux. Gadgets 360, résumant un reportage de 9to5Google, a indiqué que la fonctionnalité était décrite comme un nouveau modèle de génération vidéo capable de remixer des vidéos, de les éditer dans le chat, d’utiliser des modèles, et de prendre en charge d’autres tâches créatives.

Cela ne signifie pas que Gemini Omni est disponible pour le public. Au 15 mai 2026, Google n’a publié aucune page produit officielle Gemini Omni ni page modèle développeur confirmant l’accès, les prix, les limites ou les détails techniques. L’interprétation la plus prudente est que Gemini Omni est soit un nom de test, soit un mode vidéo Gemini à venir, soit une surcouche autour d’une infrastructure liée à Veo, soit une première étape vers un système de génération média plus unifié.

Pour les lecteurs qui demandent « qu’est-ce que Gemini Omni AI », la meilleure réponse à ce jour est : un workflow vidéo Google rapporté et encore non confirmé, qui pourrait intégrer génération, édition, remix, modèles et affinage de scènes dans une expérience plus native au chat.

Pourquoi Gemini Omni pourrait compter pour la génération de vidéo IA

Gemini Omni compte parce qu’il pointe vers une meilleure boucle créative. La plupart des outils vidéo IA actuels ressemblent encore à des systèmes « one-shot » : vous écrivez un prompt, vous générez un clip, une partie ne vous plaît pas, et vous devez souvent recommencer. Cela peut fonctionner pour des essais, mais c’est inefficace pour les créateurs qui produisent des publicités, des vidéos explicatives, des clips produit, du contenu social et des storyboards multi-plans.

Un workflow conversationnel change la nature de la tâche. Au lieu de réécrire le prompt complet, un créateur pourrait dire : « garde le produit et l’éclairage, mais ralentis le travelling avant de la caméra », ou « remplace l’arrière-plan par une rue en ville tout en conservant le personnage ». Si le système peut comprendre le clip précédent et appliquer des modifications sans casser la continuité, la vidéo IA se rapproche d’un collaborateur créatif plutôt que d’une machine à sous.

C’est pourquoi le passage rapporté du prompt one-shot à la création vidéo conversationnelle est important. Il placerait l’itération au centre du workflow.

Du prompting one-shot à la création vidéo conversationnelle

Le plus grand changement de workflow text-to-video « façon Gemini » est le passage d’une génération isolée à un affinage continu. Un Text to Video AI Generator traditionnel transforme des prompts en vidéos IA, ce qui reste le meilleur point de départ pour beaucoup de créateurs. Mais un système vidéo conversationnel conserverait le contexte après la première génération et permettrait à l’utilisateur d’affiner la même idée étape par étape.

En pratique, un workflow conversationnel pourrait ressembler à ceci :

- Générer un court clip cinématographique à partir d’un prompt.

- Demander un autre angle de caméra sans changer le personnage.

- Ajouter ou améliorer le texte sur un panneau, une affiche, un packaging ou une carte titre.

- Remixer le style visuel dans un nouveau modèle.

- Prolonger la scène ou créer un deuxième plan qui corresponde au premier.

- Exporter une version pour du contenu social vertical.

C’est particulièrement utile pour le text-to-video IA pour des clips cinématographiques, car la qualité « cinéma » dépend généralement de petites révisions. Vitesse de caméra, cadrage, éclairage, placement des acteurs, position du texte et rythme doivent tous être ajustés.

L’édition dans le chat et le remix vidéo pourraient réduire le travail de reprise

L’édition dans le chat serait la fonctionnalité Gemini Omni la plus pratique si elle fonctionne de manière fiable. Les créateurs ont rarement besoin d’une seule génération parfaite. Ils doivent supprimer un objet distrayant, changer la couleur d’un produit, ajuster un plan, remplacer un arrière-plan, ou rendre la dernière image plus propre pour des sous-titres.

Le remix vidéo compte pour la même raison. Un créateur peut vouloir qu’un clip devienne une pub produit, une intro de tutoriel, un teaser cinématographique et un short vertical. Si Gemini Omni prend en charge le remix dans le chat, le modèle pourrait traiter un clip généré comme une matière première réutilisable plutôt que comme une impasse finale.

Cependant, cela reste une capacité rapportée, pas une fonctionnalité de production confirmée. Tant que Google ne publie pas de documentation officielle Gemini Omni, les créateurs devraient considérer ces rapports comme un signal de la direction du marché plutôt que comme un outil sur lequel compter aujourd’hui.

La création basée sur des modèles pourrait aider les équipes de contenu social

La création vidéo basée sur des modèles pourrait rendre la vidéo IA plus utile pour les équipes qui publient souvent. Un modèle donne une structure au résultat : révélation produit, présentation du fondateur, publicité style UGC, explication éducative, teaser de lancement, ou post social cinématographique. Au lieu de demander au modèle d’inventer toute la vidéo, le créateur choisit un format et le remplit avec un prompt, un produit, une image ou un script.

Pour le contenu social, c’est pratique. Le meilleur générateur vidéo IA pour le contenu social n’est pas seulement celui qui a la démo la plus jolie. C’est celui qui vous aide à reproduire des formats utiles avec moins de friction. Un système de modèles pourrait rendre la vidéo IA plus prévisible, parce qu’il sépare le contenu créatif de la structure du clip.

Les créateurs peuvent déjà se préparer à ce workflow en écrivant des prompts sous forme de modules : scène, sujet, caméra, style visuel, format, besoin de texte, et image finale. Cette structure fonctionne aujourd’hui dans les outils actuels et devrait bien se transférer si Gemini Omni devient disponible.

Un meilleur rendu du texte et un contrôle de scène plus solide sont le vrai test

Un meilleur rendu du texte serait une amélioration majeure, car les outils vidéo IA ont souvent du mal à afficher des mots lisibles d’une image à l’autre. Les rapports autour de Gemini Omni mentionnent un rendu du texte plus propre, y compris des démos impliquant des équations écrites et des détails de scène. Si cela tient en usage officiel, ce serait important pour les tutoriels, les packagings, les enseignes, les clips éducatifs, les explications d’interface, les sous-titres et les accroches sociales.

Un contrôle de scène plus fort est tout aussi important. Un créateur a besoin que le même personnage, objet, produit, costume, éclairage et environnement restent stables d’un plan à l’autre. Sans cette continuité, une vidéo peut paraître impressionnante deux secondes, mais échouer en tant qu’histoire utilisable ou publicité.

C’est là que la comparaison Gemini Omni vs Veo 3.1 devient intéressante. Google confirme déjà que Veo 3.1 dans Gemini prend en charge des vidéos de haute qualité de 8 secondes avec du son, la génération audio native, et des workflows photo-to-video. Google indique aussi que Veo 3.1 peut utiliser plusieurs images de référence pour guider personnages, objets et style, et prend en charge la génération vidéo verticale pour des réseaux sociaux prêts pour mobile. Si Gemini Omni existe, la question clé est de savoir s’il se place au-dessus de ce workflow vidéo Veo 3.1, s’il l’étend de manière conversationnelle, ou s’il devient un modèle vidéo Gemini séparé.

Que faire en attendant Gemini Omni

Les créateurs n’ont pas besoin d’attendre un modèle non confirmé pour améliorer leur workflow vidéo IA. Le meilleur choix est de tester dès maintenant les entrées, prompts, comportements de modèles et critères de revue. Ainsi, si Gemini Omni sort plus tard, vous saurez déjà ce dont vous avez besoin d’un système vidéo.

HeyDream AI est une plateforme indépendante pratique pour ce type de tests, car elle réunit plusieurs workflows vidéo IA actuels. Utilisez le AI Video Generator quand vous voulez un seul espace de travail pour la création à partir de texte et d’images. Utilisez le Text to Video AI Generator quand votre idée commence par un prompt écrit et que vous voulez transformer des prompts en vidéos IA. Utilisez le Image to Video AI Generator quand vous avez déjà une image de référence, un visuel produit, un still de personnage ou une frame de style.

Pour les workflows e-commerce, le AI Product to Video Generator est utile quand votre point de départ est une image produit et que votre objectif est une vidéo de type publicité. Pour des tests spécifiques à un modèle, comparez le Google Veo 3.1 AI Video Generator, le Kling 3.0 AI Video Generator, le Seedance 2.0 AI Video Generator, et le Happy Horse 1.0 AI Video Generator sur la base du même prompt, de la même image d’entrée, du même ratio d’aspect et du même cas d’usage cible.

Cette recommandation n’affirme pas que HeyDream AI est officiellement affilié à Google. C’est une manière pratique de tester les workflows actuels de générateurs vidéo IA pour créateurs pendant que l’histoire Gemini Omni évolue.

Gemini Omni vs Veo 3.1 : une comparaison pratique

Gemini Omni vs Veo 3.1 doit être cadré avec prudence, car l’un est rapporté et l’autre est confirmé. Veo 3.1 est le modèle public actuel de génération vidéo de Google dans Gemini, avec une documentation officielle décrivant la création de vidéos de 8 secondes, le son, la génération audio native, le photo-to-video et le guidage par images de référence. Gemini Omni, en revanche, est actuellement évoqué via des rapports et des fuites.

La comparaison pratique porte sur la forme du workflow :

- Veo 3.1 : Modèle Google confirmé de génération vidéo, utile pour des workflows prompt-to-video et image-to-video avec audio.

- Gemini Omni : Workflow vidéo Gemini rapporté qui pourrait ajouter l’édition conversationnelle, le remix, les modèles et une itération plus forte.

- HeyDream AI model testing : Tests de workflows indépendants sur des cas d’usage de type Veo 3.1, Kling, Seedance, product-to-video, image-to-video et text-to-video.

Pour les créateurs, Veo 3.1 est le point de référence le plus concret. Gemini Omni est la couche possible à surveiller.

Un workflow de type Gemini que vous pouvez pratiquer dès aujourd’hui

Vous pouvez pratiquer un workflow de type Gemini même avant que Gemini Omni ne soit confirmé. L’objectif est de penser en itérations plutôt qu’en un seul prompt final.

Commencez par un brief réutilisable :

- Sujet : la personne, l’objet, le produit ou le lieu.

- Type d’entrée : prompt texte, image de référence, image produit, ou les deux.

- Format : clip cinématographique, pub verticale, tutoriel, démo produit ou accroche sociale.

- Contrôle de scène : mouvements de caméra, éclairage, environnement et besoins de continuité.

- Besoin de texte : carte titre, étiquette produit, panneau, sous-titre, ou pas de texte.

- Plan de révision : ce que vous changerez si le premier résultat est proche mais inutilisable.

Ensuite, testez le même brief sur les outils actuels. Essayez le text-to-video pour conceptualiser, l’image-to-video pour la cohérence, le product-to-video pour le commerce, et une alternative Veo 3.1 pendant que vous attendez Gemini Omni si vous souhaitez un workflow vidéo lié à Google via des pages de modèles disponibles. Prenez des notes sur ce que chaque modèle conserve, ce qu’il modifie, et le niveau de montage restant.

Lectures recommandées

Pour les workflows HeyDream AI actuels, commencez ici :

- Veo 3.1 Video Generation Guide: How to Create Cinematic Clips on HeyDream AI

- [How to Use HeyDream AI's Text-to-Video Generator: Model Comparison, Prompting Tips, and Workflows](https://heydream.im/blog/detail/How-to-Use-HeyDream-AI-s-Text-to-Video-Generator-Model-Comparison-Prompting Tips-and-Workflows-19f8eefa963c/)

- How to Create High-Quality AI Videos with Veo 3.1 on HeyDream AI

Les gens lisent aussi :

- Gemini Omni Latest Info: What Google's Rumored Video Update Could Change for AI Creators

- Gemini Omni New Model Latest Info: What We Know, What's Leaked, and What Creators Can Use Now

- SeaImagine AI Text-to-Video Guide: How to Choose Models and Create Better Clips

- How to Use the AI Music Video Generator: A Detailed Guide from Song to Video

FAQ

Qu’est-ce que Gemini Omni AI ?

Gemini Omni est une capacité de génération vidéo Google Gemini rapportée, susceptible de prendre en charge la création vidéo, le remix, les modèles et l’édition dans le chat. Elle n’a pas été officiellement confirmée comme un produit public Google au 15 mai 2026.

Gemini Omni est-il la même chose que Veo 3.1 ?

Non confirmé. Google décrit officiellement Veo 3.1 comme son modèle actuel de génération vidéo dans Gemini. Les rapports suggèrent que Gemini Omni pourrait être lié à la technologie Veo, mais Google n’a pas confirmé si Omni est un nouveau modèle, un mode Gemini, ou une surcouche autour d’une infrastructure vidéo existante.

Pourquoi les créateurs s’intéressent-ils à Gemini Omni ?

Les créateurs s’y intéressent car le workflow rapporté semble plus conversationnel que les outils vidéo IA classiques. Si cela fonctionne comme décrit, les utilisateurs pourraient générer un clip, l’éditer dans le chat, le remixer, appliquer des modèles et améliorer le texte ou les détails de scène sans recommencer depuis zéro.

Que devraient utiliser les créateurs tant que Gemini Omni reste non confirmé ?

Les créateurs peuvent utiliser des plateformes actuelles comme HeyDream AI pour tester des workflows text-to-video, image-to-video, product-to-video et spécifiques à des modèles. Cela aide à construire des habitudes reproductibles de prompting et de revue avant toute sortie confirmée de Gemini Omni.

Quel est le meilleur générateur vidéo IA pour le contenu social ?

Le meilleur générateur vidéo IA pour le contenu social est celui qui correspond à votre format, votre type d’entrée et vos besoins de révision. Testez le même prompt sur des outils text-to-video, image-to-video, product-to-video et spécifiques à des modèles, puis comparez la cohérence, le mouvement, le rendu du texte, la vitesse et l’effort de montage.

Conclusion

Gemini Omni mérite d’être surveillé, car il peut signaler la prochaine étape de la génération vidéo IA : création conversationnelle, édition dans le chat, remix vidéo, production basée sur des modèles, meilleur rendu du texte et contrôle de scène plus solide. La réserve importante est que Gemini Omni reste non confirmé, donc les créateurs doivent distinguer les capacités rapportées des faits officiels des produits Google.

En attendant, utilisez HeyDream AI comme plateforme créative indépendante pour tester les workflows vidéo IA actuels, notamment AI Video Generator, Text to Video AI Generator, Image to Video AI Generator, AI Product to Video Generator, Google Veo 3.1 AI Video Generator, Kling 3.0 AI Video Generator, Seedance 2.0 AI Video Generator et Happy Horse 1.0 AI Video Generator. La meilleure préparation à Gemini Omni est de construire dès maintenant un workflow reproductible, puis de changer de modèle lorsque des outils confirmés rattraperont le niveau attendu.

SEO Title:

Meta Description:

Tags: , générateur vidéo IA, , Veo 3.1, HeyDream AI, workflow vidéo IA